Intel presenta una serie de tecnologías para llevar la IA a todas partes

En la tercera edición de su evento anual Intel Innovation, Intel presentó una serie de tecnologías para llevar la inteligencia artificial a todas partes y hacerla más accesible en todas las cargas de trabajo, desde el cliente y el borde hasta la red y la nube.

En una presentación inaugural del evento dirigida a desarrolladores, Gelsinger mostró cómo Intel está incorporando las capacidades de IA a sus productos de hardware y haciéndolas accesibles a través de soluciones de software abiertas y de múltiples arquitecturas. También destacó cómo la IA está ayudando a impulsar la Siliconomía, una economía en crecimiento posible gracias a la magia del silicio y el software. En la actualidad, el silicio alimenta una industria de USD 574 mil millones, la cual, a su vez, impulsa una economía tecnológica mundial valorada en casi USD 8 billones.

Nuevos avances en silicio, embalaje y soluciones multi chiplet

El trabajo comienza con la innovación del silicio. El programa de desarrollo de procesos de cinco nodes en cuatro años de Intel avanza a buen ritmo, según Gelsinger, con Intel 7 ya en producción en alto volumen, Intel 4 listo para la fabricación e Intel 3 en camino para finales de este año.

Gelsinger también presentó una oblea Intel 20A con los primeros chips de prueba para su procesador Arrow Lake, que estará disponible para el mercado de computación cliente en 2024. El Intel 20A será el primer node de proceso que incluirá PowerVia, la tecnología de suministro de energía por porta trasera de Intel, y el nuevo diseño de transistor con puerta de acceso perimetral denominado RibbonFET. El Intel 18A, que también se beneficiará de PowerVia y RibbonFET, sigue teniendo su fabricación prevista para inicio en la segunda mitad de 2024.

Otra forma en que Intel impulsa la Ley de Moore hacia adelante es mediante nuevos materiales y nuevas tecnologías de empaque, como los sustratos de vidrio, un avance que Intel anunció esta semana. Cuando se introduzcan más adelante en esta década, los sustratos de vidrio permitirán seguir escalando los transistores en un paquete para satisfacer la demanda de cargas de trabajo intensivas en datos y de alto rendimiento, como la inteligencia artificial, y permitirán que la Ley de Moore continúe mucho más allá de 2030.

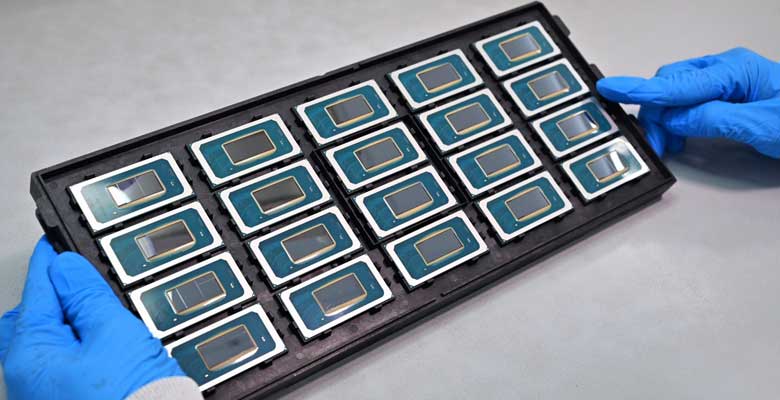

Asimismo, la compañía presentó un paquete de chips de prueba desarrollado con Universal Chiplet Interconnect Express (UCIe). La próxima ola de la Ley de Moore vendrá con paquetes de múltiples chips, dijo Gelsinger, y llegará antes si los estándares abiertos pueden reducir la fricción de la integración de IP. Constituido el año pasado, el estándar UCIe permitirá que los chips de distintos proveedores trabajen juntos, posibilitando nuevos diseños para la expansión de diversas cargas de trabajo de IA. La especificación abierta cuenta con el apoyo de más de 120 compañías.

El chip de prueba combinó un chip IP Intel UCIe fabricado con Intel 3 y un chip IP Synopsys UCIe fabricado con el node de proceso TSMC N3E. Los chips se conectan mediante la avanzada tecnología de embalaje que utiliza puente de interconexión de múltiples matrices (EMIB) integrado. La presentación pone de relieve el compromiso de TSMC, Synopsys e Intel Foundry Services de apoyar a un ecosistema de chips basado en estándares abiertos con UCIe.

Aumentando el Rendimiento y Expandiendo la IA a Todas Partes

Gelsinger destacó la gama de tecnología de IA disponible actualmente para los desarrolladores en todas las plataformas Intel y cómo dicha gama aumentará drásticamente durante el próximo año.

Los recientes resultados de rendimiento de inferencia de MLPerf IA refuerzan aún más el compromiso de Intel de abordar cada fase del continuo de la inteligencia artificial, incluso una IA generativa más grande y desafiante, así como los grandes modelos de lenguaje. Los resultados también destacan el acelerador Intel Gaudi como la única alternativa viable en el mercado para las necesidades computacionales de IA. Gelsinger anunció que se construirá una gran supercomputadora de IA completamente basada en procesadores Intel Xeon y 4,000 aceleradores de hardware de IA Intel Gaudi, con Stability AI como cliente principal.

Intel también anticipó que los procesadores Intel Xeon de 5ta generación aportarán una combinación de mejoras de rendimiento y memoria más rápida a los centros de datos de todo el mundo, mientras usa la misma cantidad de energía, cuando se lancen, el 14 de diciembre. El Sierra Forest, que se lanzará en la primera mitad de 2024 con eficiencia E-core, ofrecerá 2,5 veces más densidad de rack y 2,4 veces más rendimiento por vatio que el Xeon de 4ta generación, e incluirá una versión con 288 núcleos. Y el Granite Rapids, con rendimiento P-core, seguirá de cerca el lanzamiento del Sierra Forest, ofreciendo de 2 a 3 veces más rendimiento de IA en comparación con los Xeon de 4 generación.

Con vistas a 2025, la próxima generación del procesador E-core Xeon, cuyo nombre en clave es Clearwater Forest, llegará con el node de proceso Intel 18A.

Presentamos el AI PC con procesadores Intel Core Ultra

La inteligencia artificial también está a punto de volverse más personal.Esta nueva experiencia de PC se materializará con los próximos procesadores Intel Core Ultra, cuyo nombre en clave es Meteor Lake, que contarán con la primera unidad de procesamiento neuronal (NPU) integrada de Intel, para acelerar la IA y la inferencia local en el PC con un consumo eficiente de energía. Gelsinger confirmó que el Intel Core Ultra también se lanzará el 14 de diciembre.

Core Ultra representa un punto de inflexión en la trayectoria de los procesadores cliente de Intel: es el primer diseño de chip de cliente con tecnología de embalaje Foveros. Además de la NPU y de los grandes avances en eficiencia energética gracias a la tecnología de proceso Intel 4, el nuevo procesador aporta rendimiento de gráficos discretos con GPU Intel Arc integrada.

En el escenario, Gelsinger mostró una serie de nuevos casos de uso de PC con IA, y Jerry Kao, director de operaciones de Acer, ofreció un adelanto de un nuevo laptop equipado con Core Ultra.

Dando a los Desarrolladores el Manejo de la Siliconomía

Para ayudar a los desarrolladores a desvelar este futuro, Intel ha anunciado:

- Disponibilidad general de la Intel Developer Cloud: ayuda a los desarrolladores a acelerar la IA utilizando las últimas innovaciones de hardware y software de Intel, incluyendo procesadores Intel Gaudi para aprendizaje profundo, y proporciona acceso a las más nuevas plataformas de hardware de Intel, como los procesadores Intel Xeon Scalable de 5ta generación y las GPU Intel Data Center GPU Max Series 1100 y 1550. Al utilizar la Intel Developer Cloud, los desarrolladores pueden crear, probar y optimizar aplicaciones de IA y HPC. También pueden ejecutar cargas de trabajo de entrenamiento, optimización de modelos e inferencia de IA, de pequeña a gran escala, que se implementan con rendimiento y eficiencia.

- Versión 2023.1 de la Distribución Intel del kit de herramientas OpenVINO: OpenVINO es el motor de inferencias y ejecución de IA de Intel preferido por los desarrolladores en plataformas cliente y periféricas. La actualización incluye modelos preentrenados y optimizados para integración con distintos sistemas operativos y soluciones en la nube, incluidos muchos modelos generativos de IA, como el modelo Llama 2 de Meta. En el escenario, compañías como AI.IO y Fit:Match demostraron cómo utilizan OpenVINO para acelerar sus aplicaciones: AI.IO para evaluar el rendimiento de los jugadores de fútbol; Fit:Match para para revolucionar las industrias minoristas y de bienestar para ayudar a los consumidores a encontrar las prendas que mejor les quedan.

- Proyecto Strata y el desarrollo de una plataforma de software nativa del borde: la plataforma se lanzará en 2024 con bloques de construcción modulares, ofertas de soporte y servicio premium.

Se trata de un abordaje horizontal para escalar la infraestructura necesaria al borde inteligente y a la IA híbrida, reuniendo un ecosistema de aplicaciones verticales de Intel y de terceros. La solución permitirá a los desarrolladores crear, implementar, ejecutar, gestionar, conectar y proteger las infraestructuras y aplicaciones perimetrales distribuidas.